منصة Instagram تتعرض لأزمة علاقات عامة: Meta تعتذر بعد تدفق محتوى صادم في Reels

⬤ اعتذرت Meta عن خلل تقني في Instagram تسبب في تدفق محتوى صادم وعنيف داخل Reels.

⬤ أثار الحادث استياء المستخدمين، حتى مع تفعيل أدوات التحكم في المحتوى، مما شكك في فعاليتها.

⬤ ربط مراقبون الخلل بتخفيض فرق الإشراف وتغييرات Meta بسياسات المحتوى، مما أضعف الرقابة الرقمية.

في ظل التحديات المستمرة لمراقبة المحتوى على وسائل التواصل الاجتماعي، وجدت Meta، الشركة المالكة لمنصة Instagram، نفسها مضطرة لتقديم اعتذار علني بعد خطأ تقني تسبب في اجتياح Reels بمحتوى صادم وعنيف.

أكدت Meta يوم الخميس أنها أصلحت «خطأ» أدى إلى ظهور محتوى غير لائق في Reels لبعض المستخدمين، وتقدمت باعتذار رسمي شديد اللهجة، على لسان متحدث باسم الشركة. غير أن هذا الاعتذار لم يكن كافياً بالنسبة لكثير من المستخدمين، الذين أعربوا عن استيائهم عبر وسائل التواصل الاجتماعي، حيث عجت المنصات مثل Reddit بشهادات صادمة عن طبيعة المحتوى الذي ظهر فجأة في حسابات المستخدمين.

على سبيل المثال، أفاد بعض المستخدمين بأن موجز Reels لديهم امتلأ فجأة بمقاطع عن «مشاجرات عنيفة في الشوارع، وإطلاق نار في المدارس، وجرائم قتل، وحوادث مروعة»، بينما قال آخرون إنهم انتقلوا من مشاهدة مقاطع عن الطائرات، والساعات، والرسم، والقطط، إلى محتوى يتضمن مشاهد جسدية مرعبة وكتابات باللغة الروسية. والأسوأ من ذلك، أن بعض المستخدمين أكدوا أنهم تعرضوا لمحتوى يتضمن استغلالاً للأطفال، وهو ما يبرز خطورة هذا الخلل.

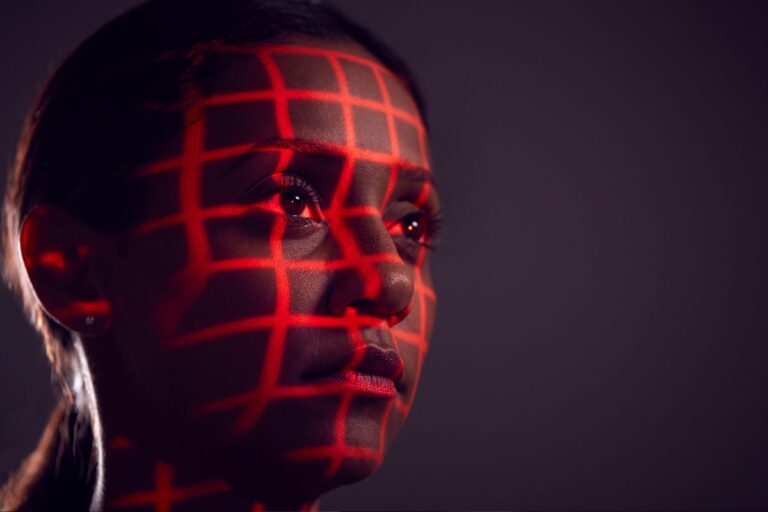

المفارقة الصادمة أن بعض المستخدمين الذين قاموا بتفعيل خيار «التحكم في المحتوى الحساس» في أعلى مستوياته وجدوا أنفسهم رغم ذلك غارقين في هذا المحتوى غير اللائق، مما يثير تساؤلات حول فعالية أدوات Meta في الحد من المواد غير المرغوب بها.

بحسب سياسة الشركة، فإنها تحظر بشكل صريح المحتوى الذي يتضمن «مشاهد لتقطيع الأجساد، أو أعضاء داخلية مكشوفة، أو جثث محترقة»، إلى جانب «صور تعكس معاناة البشر والحيوانات.» ورغم السماح ببعض المواد التي تتضمن مشاهد عنف لأغراض التوعية بقضايا حقوق الإنسان والصراعات، لا يبدو أن ما اجتاح Reels يندرج تحت هذا التصنيف.

تؤكد Meta أن لديها أنظمة قوية لمكافحة المحتوى الصادم، مشيرة إلى استخدامها تقنيات الذكاء الاصطناعي، وفريق يضم أكثر من 15 ألف مراجع بشري يعمل على إزالة المحتوى المخالف. ومع ذلك، فإن هذه الواقعة تضع علامة استفهام كبيرة حول قدرة هذه الأنظمة على التصدي لمثل هذه الأخطاء. وبحسب ما تنشره Meta على موقعها الرسمي، فإن تقنياتها تزيل «الغالبية العظمى من المحتوى المخالف» قبل أن يتم الإبلاغ عنه، وهو ادعاء يبدو الآن بعيداً عن الواقع في ظل ما حدث.

تأتي هذه الحادثة في وقت حساس للغاية بالنسبة لشركة Meta، التي أعلنت مؤخراً عن تغييرات جذرية في سياسات الإشراف على المحتوى، تحت شعار تعزيز حرية التعبير. وشملت هذه التغييرات تفكيك برامج التحقق من المعلومات، وتخفيف القيود المفروضة على بعض أنواع خطاب الكراهية، وتقليل الأولوية الممنوحة لمبادرات التنوع والمساواة والشمول (DEI). وقاد جاء ذلك أيضاً عقب موجة تسريح واسعة للموظفين في 2022 و2023، أدت لفقدان 21 ألف موظف وظائفهم، ومن بينهم أعضاء بارزون في فرق السلامة والنزاهة الرقمية.

يرى كثير من المراقبين أن هذا التغيير في السياسات، إلى جانب تقليص فرق الإشراف، قد يكون السبب المباشر وراء التدفق المفاجئ لهذا المحتوى. فيما ألقى بعض المستخدمين باللوم على «ذكاء اصطناعي خرج عن السيطرة»، بينما اعتبر آخرون أن ما حدث هو نتيجة غير مباشرة «لقرارات سيئة في الإدارة» وتخفيض الإنفاق على فرق الإشراف.