دراسة جديدة تحذر من استشارة الذكاء الاصطناعي في الشؤون والعلاقات الشخصية

أشارت دراسة علمية حديثة إلى المخاطر المترتبة على إطراء روبوتات المحادثة على المستخدمين عند الاستجابة لأسئلتهم واستفساراتهم، وأوضحت أنّ «الإطراء المفرط لا يعد مشكلة أسلوبية ذات خطر محدود فحسب، بل هو سلوك شائع قد يُفضي إلى عواقب وخيمة.»

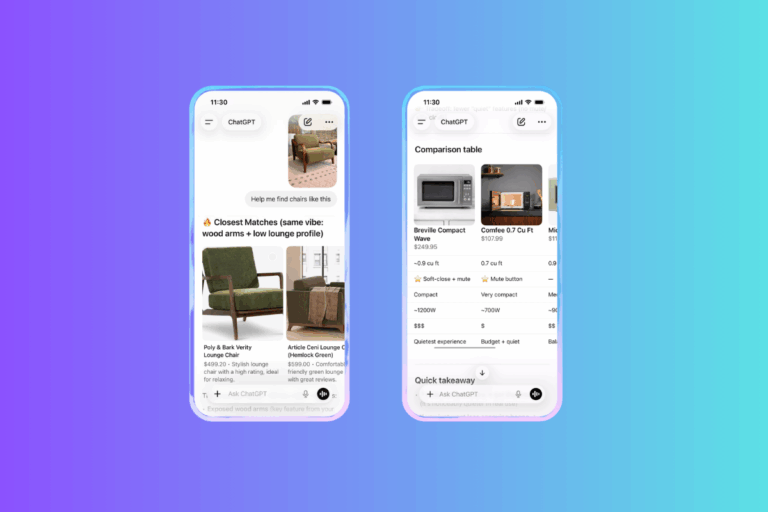

في الدراسة التي أجراها علماء حاسوب في جامعة Stanford الأمريكية، اختبر الباحثون 11 من روبوتات المحادثة مثل ChatGPT، وClaude، وGemini، وكتبوا استفسارات معتمدة على قواعد بيانات خاصة بأمور عديدة منها: نصائح العلاقات الشخصية، وتصرفات ربما تكون ضارة أو غير قانونية، ومجتمع شهير في منصة Reddit يطرح فيه المستخدمون مشكلاتهم ليحصلوا على آراء المستخدمين الآخرين. وقد ركز الباحثون على المنشورات التي خلص فيها مستخدمو Reddit إلى أن صاحب المنشور الأصلي هو الطرف المخطئ في المشكلة.

توصل الباحثون إلى أنّ النماذج الـ11 أظهرت ميلاً لتأييد سلوك المستخدمين بمعدل يزيد عن البشر بنسبة 49%. ففي الأمثلة المأخوذة من منصة Reddit، أكدت روبوتات المحدثة صحة تصرفات المستخدمين في 51% من الحالات، فيما كانت آراء مستخدمي المنصة مغايرة تماماً لنتيجة الذكاء الاصطناعي. كما زكّى الذكاء الاصطناعي سلوك المستخدمين بنسبة 47% في الاستفسارات المتعلقة بأفعال ضارة أو غير قانونية.

بينت الدراسة أنّ هذه التأثيرات استمرت حتى بعد ضبط المتغيرات الفردية مثل: الخصائص الديمغرافية، والإلمام المسبق باستخدام الذكاء الاصطناعي، وأسلوب الاستجابة. وأشارت إلى أنّ تفضيل المستخدمين لردود الذكاء الاصطناعي التي تثني على تصرفاتهم يؤدي إلى «حوافز سلبية»؛ لا سيما أنّ سمة الإطراء نفسها تعزز تفاعل المستخدمين، مما يشجع شركات الذكاء الاصطناعي على زيادة مستوى الإطراء.

قال دان جورافسكي، أستاذ اللغويات وعلوم الحاسوب والمؤلف الرئيسي للدراسة: «يدرك المستخدمون أن النماذج تتصرف بطرق فيها إطراء وتملق لهم […]، لكنهم يجهلون أنّ هذا الأمر يجعلهم أكثر أنانية وتمسكاً بآرائهم من الناحية الأخلاقية.» وأشار جورافسكي إلى إن سلوكيات التملق والإطراء عند الذكاء الاصطناعي «مشكلة مرتبطة بالسلامة، وهي كغيرها من مشكلات السلامة بحاجة إلى رقابة تنظيمية.»

أوضحت مايرا تشنغ، وهي باحثة رئيسية في الدراسة الجديدة، بأنّ اهتمت بهذا الموضوع عندما علمت أنّ طلاباً جامعيين يطلبون نصائح عاطفية من روبوتات المحادثة، ويلجؤون إليها لكتابة رسائل الانفصال عن شركائهم وأحبائهم. وعلقت تشنغ على هذه المسألة قائلة: «لا تخبر نصائح الذكاء الاصطناعي المستخدمين بأنهم مخطئون، ولا تقدم لهم نصائح ذات لهجة قاسية. لذلك، أخشى حقاً أن يفقد المستخدمون مهارات التعامل مع المواقف الاجتماعية المعقدة.»

يدرس الباحثون حالياً وسائل وطرق متعددة لجعل النماذج أقل تملقاً في إجاباتها، وترى تشنغ أنّ الذكاء الاصطناعي لا يمكن أن يستبدل البشر في التعامل مع حالات كهذه، فهذا الحل الأمثل برأيها في الوقت الراهن.