باحثون: الذكاء الاصطناعي التوليدي لا يهلوس، بل إنه ينتج الهراء

⬤ قال عدد من الباحثين أن أخطاء الذكاء الاصطناعي التوليدي لا يجب أن توصف بالهلوسة، بل الهراء.

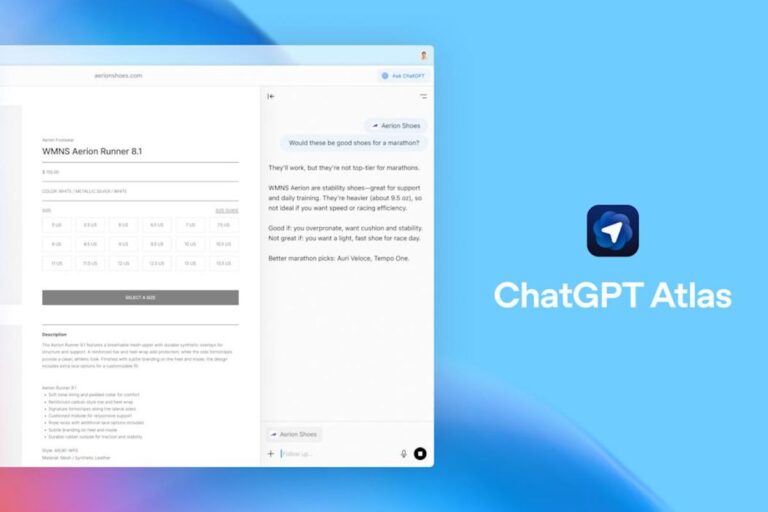

⬤ في ورقة بحثية، وصف الباحثون ChatGPT بكونه مثالاً على مصادر الهراء البريء وغير المقصود.

⬤ قال الباحثون أن تسمية أخطاء الذكاء الاصطناعي بالهلوسة خطأ جسيم يحمل الكثير من الخطورة كذلك.

يبدو أن الوقت قد حان لوضع مخرجات النماذج اللغوية الكبيرة للذكاء الاصطناعي ضمن أطرها الفلسفية والمعرفية السليمة، وتسمية الأمور بمسمياتها الدقيقة. ففي ورقة بحثية جديدة نُشرت في مجلة Ethics and Information Technology، يجادل ثلاثة باحثين في الفلسفة من جامعة غلاسكو في اسكتلندا بأن وصف ميل برامج المحادثة إلى اختلاق الهراء لا ينبغي أن يشار إليه على أنه «هلوسات»، بل يجب وصفه بالاسم الحقيقي الأقل تقبلاً ربما.

من منظور علم النفس، عادة ما تعرف الهلوسة بأنها رؤية أو إدراك شيء غير موجود. وبناء على ذلك، يرى القائمون على البحث أن استخدام هذا المصطلح في سياق الذكاء الاصطناعي هو أمر مجازي، لأن النماذج اللغوية الكبيرة (LLMs) لا ترى أو تدرك أي شيء على الإطلاق، لذا، فإن هذا التشبيه يجانب الصواب في ظل وجود تعبير جاهز لمفهوم «الهراء» متاح للاستخدام.

تستند حجة الباحثين على أحد مؤلفات الفيلسوف هاري فرانكفورت الممتعة واللاذعة في مجال نظرية المعرفة تحت عنوان «عن الهراء (On Bullshit)» والذي صدر عام 2005. حيث يوجز فريق غلاسكو تعريف فرانكفورت العام للهراء على أنه «أي كلام يصدره المتحدث دون اكتراث بحقيقة الكلام»، وينقسم هذا التفسير بدوره إلى نوعين؛ الهراء «الخبيث»، وهو الهراء الصادر عن شخص مع نية مسبقة لتضليل المتلقين وإحادتهم عن الحقيقة، والهراء «البريء»، والذي يُنطق دون أي نية للتضليل.

حول هذا الأمر، يشير الباحثون بالقول: «يعتبر ChatGPT على الأقل مصدراً للهراء البريء أو آلة للهراء، لأنه إن لم يكن فاعلاً، فهو غير قادر على أن يتبنى أي مواقف تجاه الحقيقة ولا أن يخدع المستمعين بشأن مآربه (أو لربما مآرب مشغليه بتعبير أدق).»

عوضاً عن امتلاكها أي نية مبيتة أو غرض مسبق، لدى برامج المحادثة هدف واحد؛ الإتيان بنص يشبه النص البشري. وقد استشهد الباحثون بواقعة المحامي الذي استخدم ChatGPT لكتابة مذكرة قانونية وانتهى به الأمر بتقديم مجموعة من السوابق القانونية الزائفة أمام القاضي، ليؤكدوا أن النماذج اللغوية الكبيرة قد أثبتت براعتها في إصدار الهراء، الأمر الذي قد يغدو أكثر خطورة مع استمرار الناس في الاعتماد على برامج المحادثة للقيام بالعمل نيابة عنهم.

ضمن مخرجات البحث، خلص الباحثون للقول بأن: «المستثمرين وصناع السياسات وأفراد الجمهور العام يتخذون قرارات بشأن كيفية التعامل مع هذه الآلات وكيفية التصرف تجاهها ليس بناء على فهم تقني عميق لكيفية عملها، إنما على الطريقة المجازية التي يتم بها توصيل قدراتها ووظائفها في الغالب. وإن وصف أخطائها بأنها هلوسات ليس بالأمر الحميد؛ فهو يؤدي إلى الالتباس بأن الآلات تسيء الفهم بطريقة ما، ولكنها مع ذلك تحاول نقل شيء تظنه أو أدركته.»